Hvorfor kunstig intelligens ikke eksisterer endnu

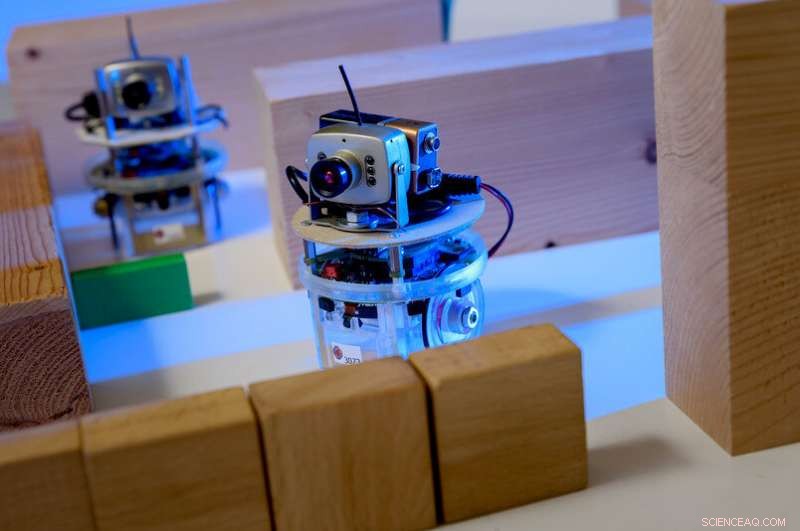

Eksempel på en læringsagent i et computerspil:Karakteren styres af en menneskelig spiller. Øjnene er agenterne. Spilleren formodes at guide agenterne på en sådan måde, at de udfører en opgave, for eksempel uden at løbe ind i en forhindring først. Uddannelse er baseret på en maskinlæringsproces; alt, hvad spilleren gør, er at skitsere grove krav. Kredit:RUB, Institut for Neuroinformatik

De processer, der ligger til grund for kunstig intelligens i dag, er faktisk ret dumme. Forskere fra Bochum forsøger at gøre dem klogere.

Radikale ændringer, revolution, megatrend, måske endda en risiko:kunstig intelligens har trængt ind i alle industrielle segmenter og holder medierne travlt. Forskere ved RUB Institute for Neural Computation har studeret det i 25 år. Deres vejledende princip er:for at maskiner skal være virkelig intelligente, nye tilgange skal først gøre maskinlæring mere effektiv og fleksibel.

"Der er to typer maskinlæring, der er vellykkede i dag:dybe neurale netværk, også kendt som Deep Learning, samt forstærkningslæring, "forklarer professor Laurenz Wiskott, Formand for teori om neuronale systemer.

Neurale netværk er i stand til at træffe komplekse beslutninger. De bruges ofte i billedgenkendelsesprogrammer. "De kan, for eksempel, fortæl ud fra fotos, om motivet er en mand eller en kvinde, «siger Wiskott.

Arkitekturen i sådanne netværk er inspireret af netværk af nerveceller, eller neuroner, i vores hjerne. Neuroner modtager signaler via flere inputkanaler og beslutter derefter, om de sender signalet i form af en elektrisk puls til de næste neuroner eller ej.

Neurale netværk modtager ligeledes flere indgangssignaler, for eksempel pixels. I et første trin, mange kunstige neuroner beregner et udgangssignal fra flere indgangssignaler ved blot at gange inputene med forskellige, men konstante vægte og derefter tilføje dem. Hver af disse aritmetiske operationer resulterer i en værdi, der - for at holde sig til eksemplet med mand/kvinde - bidrager lidt til beslutningen for kvinde eller mand. "Resultatet er lidt ændret, imidlertid, ved at indstille negative resultater til nul. Det her, også, kopieres fra nerveceller og er afgørende for ydelsen af neurale netværk, ”forklarer Laurenz Wiskott.

Det samme sker igen i det næste lag, indtil netværket kommer til en beslutning i sidste fase. Jo flere faser der er i processen, jo mere kraftfuld det er - neurale netværk med mere end 100 stadier er ikke ualmindeligt. Neurale netværk løser ofte diskrimineringsopgaver bedre end mennesker.

Læringseffekten af sådanne netværk er baseret på valget af de rigtige vægtningsfaktorer, som i første omgang vælges tilfældigt. "For at træne et sådant netværk, indgangssignalerne samt hvad den endelige beslutning skal være, er specificeret fra starten, "uddyber Laurenz Wiskott. Således, netværket er i stand til gradvist at justere vægtningsfaktorerne for endelig at træffe den korrekte beslutning med størst sandsynlighed.

Forstærkningslæring, på den anden side, er inspireret af psykologi. Her, hver beslutning, der træffes af algoritmen - eksperter omtaler det som agenten - belønnes eller straffes. "Forestil dig et gitter med agenten i midten, "illustrerer Laurenz Wiskott." Dets mål er at nå den øverste venstre boks med den kortest mulige rute - men det ved det ikke. "Det eneste agenten ønsker er at få så mange belønninger som muligt, ellers er det uvidende. I starten den bevæger sig tilfældigt over hele linjen, og hvert trin, der ikke når målet, vil blive straffet. Kun skridtet mod målet resulterer i en belønning.

Hvilken rute skal robotten tage? Denne beslutning er baseret på utallige aritmetiske operationer. Kredit:Roberto Schirdewahn

For at lære, agenten tildeler en værdi til hvert felt, der angiver, hvor mange trin der er tilbage fra denne position til dens mål. I første omgang, disse værdier er tilfældige. Jo mere erfaring agenten får på sit bord, jo bedre det kan tilpasse disse værdier til virkelige forhold. Efter mange løb, den er i stand til at finde den hurtigste vej til sit mål og, følgelig, til belønningen.

"Problemet med disse maskinlæringsprocesser er, at de er ret dumme, "siger Laurenz Wiskott." De underliggende teknikker går tilbage til 1980'erne. Den eneste grund til deres nuværende succes er, at vi i dag har mere computerkapacitet og flere data til rådighed. "På grund af dette, det er muligt hurtigt at køre de praktisk talt ineffektive læringsprocesser utallige gange og fodre neurale netværk med en overflod af billeder og billedbeskrivelser for at træne dem.

"Det, vi vil vide, er:hvordan kan vi undgå alt det lange, meningsløs træning? Og frem for alt:hvordan kan vi gøre maskinlæring mere fleksibel? "Som Wiskott kortfattet udtrykker det. Kunstig intelligens kan være bedre end mennesker i præcis den ene opgave, den blev trænet til, men den kan ikke generalisere eller overføre sin viden til relaterede opgaver.

Det er derfor, forskerne ved Institute for Neural Computation fokuserer på nye strategier, der hjælper maskiner med at opdage strukturer autonomt. "Til denne ende, vi implementerer princippet om uovervåget læring, "siger Laurenz Wiskott. Mens dybe neurale netværk og forstærkningslæring er baseret på at præsentere det ønskede resultat eller belønne eller straffe hvert trin, forskerne lader læringsalgoritmer stort set alene med deres input.

"En opgave kan være for eksempel, at danne klynger, "forklarer Wiskott. Til dette formål, computeren instrueres i at gruppere lignende data. Med hensyn til punkter i et tredimensionelt rum, dette ville betyde gruppering af punkter, hvis koordinater er tæt på hinanden. Hvis afstanden mellem koordinaterne er større, de ville blive tildelt forskellige grupper.

"Tilbage til eksemplet med billeder af mennesker, man kunne se på resultatet efter grupperingen og ville sandsynligvis opdage, at computeren har sammensat en gruppe med billeder af mænd og en gruppe med billeder af kvinder, "uddyber Laurenz Wiskott." En stor fordel er, at alt, hvad der kræves i begyndelsen, er fotos, snarere end en billedtekst, der indeholder løsningen på gåden til træningsformål, som det var."

Langsomhedsprincippet

I øvrigt, denne metode giver mere fleksibilitet, fordi en sådan klyngedannelse ikke kun gælder for billeder af mennesker, men også for biler, planter, huse eller andre genstande.

En anden tilgang, som Wiskott forfølger, er langsomhedsprincippet. Her, det er ikke fotos, der udgør input -signalet, men bevægelige billeder:hvis alle funktioner udtrækkes fra en video, der ændrer sig meget langsomt, opstår strukturer, der hjælper med at opbygge en abstrakt repræsentation af miljøet. "Her, også, pointen er at forstrukturere inputdata, "påpeger Laurenz Wiskott. Til sidst, forskerne kombinerer sådanne tilgange på en modulær måde med metoder til overvåget læring, for at skabe mere fleksible applikationer, der ikke desto mindre er meget præcise.

"Øget fleksibilitet resulterer naturligvis i præstationstab, "indrømmer forskeren. Men på sigt, fleksibilitet er uundværlig, hvis vi vil udvikle robotter, der kan håndtere nye situationer. "

Sidste artikelForudsiger forurening med tingenes internet

Næste artikelDieselinnovation har en ydmyg begyndelse

Varme artikler

Varme artikler

-

Air Force opnår rekordsættende hypersonisk jordtestmilepælAEDC Aerodynamisk og Propulsion Test Unit på Arnold Air Force Base understøtter nylige tests for Air Force Research Laboratory Medium Scale Critical Components Scramjet-programmet. Den Northrop Grumma

Air Force opnår rekordsættende hypersonisk jordtestmilepælAEDC Aerodynamisk og Propulsion Test Unit på Arnold Air Force Base understøtter nylige tests for Air Force Research Laboratory Medium Scale Critical Components Scramjet-programmet. Den Northrop Grumma -

Hvordan Epic Games CEO Tim Sweeney ændrede videospilindustrienKredit:CC0 Public Domain Det ville være svært at finde en lokal virksomhed, der har haft større indflydelse rundt om i verden i de seneste år end Epic Games. Siden udgivelsen af Fortnite, et af

Hvordan Epic Games CEO Tim Sweeney ændrede videospilindustrienKredit:CC0 Public Domain Det ville være svært at finde en lokal virksomhed, der har haft større indflydelse rundt om i verden i de seneste år end Epic Games. Siden udgivelsen af Fortnite, et af -

Vil FAA'er planlægge, at 737 MAX flyver uden for USA?Den globale flåde af Boeing 737 MAX-fly er sat på grund efter to dødbringende styrt, herunder denne gruppe af Southwest Airlines fly fotograferet i Californien i marts At få Boeings bedst sælgende

Vil FAA'er planlægge, at 737 MAX flyver uden for USA?Den globale flåde af Boeing 737 MAX-fly er sat på grund efter to dødbringende styrt, herunder denne gruppe af Southwest Airlines fly fotograferet i Californien i marts At få Boeings bedst sælgende -

Kunstigt led genopretter håndledslignende bevægelser til amputerede underarmeEt implantat placeres i hver af de to knogler i underarmen - ulna og radius - og derefter fungerer et håndledslignende kunstigt led som en grænseflade mellem disse to implantater og den protetiske hån

Kunstigt led genopretter håndledslignende bevægelser til amputerede underarmeEt implantat placeres i hver af de to knogler i underarmen - ulna og radius - og derefter fungerer et håndledslignende kunstigt led som en grænseflade mellem disse to implantater og den protetiske hån

- Stigende snedybde forhindrede vinterjorden i at køle af under opvarmningen

- Boeing lander stor British Airways ordre, efter Airbus slutter A380

- Dissektering af kolloidale briller ved hjælp af laser som lancet

- Kulstofomkostningerne ved hjemmelevering og hvordan man undgår det

- Det kinesiske bilsalg falder for anden måned i august

- Studerer kanten af solens magnetiske boble