For at stoppe en teknisk apokalypse har vi brug for etik og kunst

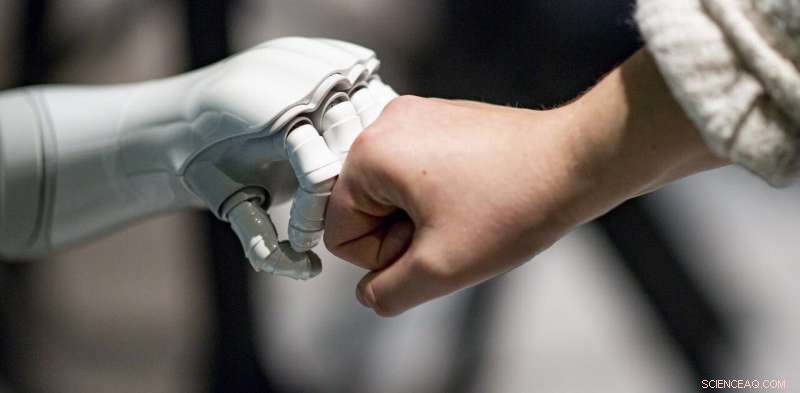

Hvordan kan vi sikre, at nye teknologier forbliver centreret om menneskers velvære? Kredit:Axel Heimken / DPA

Hvis de seneste tv-shows er noget at gå efter, vi er lidt bekymrede over konsekvenserne af den teknologiske udvikling. Dystopiske fortællinger florerer.

Black Mirror projicerer de negative konsekvenser af sociale medier, mens kunstig intelligens bliver useriøs i The 100 and Better Than Us. Den potentielle udryddelse af den menneskelige race er på højkant i Traveller, og Altered Carbon bekymrer sig over adskillelsen af menneskelig bevidsthed fra kroppen. Og Humans og Westworld ser problemer forude for relationer mellem mennesker og Android.

Fortællinger som disse har en lang slægt. Science fiction har i det mindste siden Mary Shelleys Frankenstein (1818) formuleret vores håb og frygt om teknologisk forstyrrelse.

Imidlertid, som førerløse biler og robotterapeuter dukker op, nogle tidligere fiktive bekymringer er ikke længere fantasifulde spekulationer. I stedet, de repræsenterer reelle og presserende problemer.

Hvilken slags fremtid ønsker vi?

Sidste år, Australiens chefvidenskabsmand Alan Finkel foreslog, at vi i Australien skulle blive "menneskelige vogtere." Dette ville betyde at være førende inden for teknologisk udvikling, etik, og menneskerettigheder.

Finkel er ikke alene i sin bekymring. Men det vil ikke være nemt at løse disse problemer i udviklingen af ny teknologi.

Mange mennesker i regeringen, industri og universiteter hævder nu, at inddragelse af perspektiver fra humaniora og samfundsvidenskab vil være en nøglefaktor.

En nylig rapport fra Australian Council of Learned Academies (ACOLA) samlede eksperter fra videnskabelige og tekniske områder såvel som humaniora, kunst og samfundsvidenskab til at undersøge nøglespørgsmål, der opstår fra kunstig intelligens.

Ifølge formanden for ACOLA-bestyrelsen, Hugh Bradlow, rapporten har til formål at sikre, at "samfundets velfærd" placeres "i centrum for enhver udvikling."

Menneskecentreret AI

En lignende vision driver Stanford University's Institute for Human-Centered Artificial Intelligence. Instituttet samler forskere fra humaniora, uddannelse, lov, medicin, business og STEM til at studere og udvikle "menneskecentrerede" AI-teknologier. Tanken bag deres arbejde er, at "AI skal være samarbejdende, forstærkende og forbedrende for menneskelig produktivitet og livskvalitet."

I mellemtiden på tværs af Atlanten, Future of Humanity Institute ved University of Oxford undersøger på samme måde "store spørgsmål" for at sikre "en lang og blomstrende fremtid for menneskeheden."

Centret skal fordobles i størrelse i det næste år takket være et bidrag på £13,3 millioner (25 millioner A$) fra Open Philanthropy Project. Grundlæggeren af instituttet, filosof Nick Bostrom, sagde:"Der er et langdistancekapløb mellem menneskehedens teknologiske formåen, som er som en hingst, der galopperer over markerne, og menneskehedens visdom, hvilket er mere som et føl på ustabile ben."

Hvad skal man bygge og hvorfor

IT-sektoren kæmper også med de etiske spørgsmål, der rejses af hurtige teknologiske fremskridt. Microsofts Brad Smith og Harry Shum skrev i deres bog The Future Computed fra 2018, at en af deres "vigtigste konklusioner" var, at humaniora og samfundsvidenskab har en afgørende rolle at spille i forhold til at konfrontere de udfordringer, som AI rejser:

"Sprog, kunst, historie, økonomi, etik, filosofi, psykologi og menneskelig udvikling kurser kan undervise kritiske, filosofiske og etikbaserede færdigheder, der vil være medvirkende til udvikling og styring af AI-løsninger.

"Ansættelsespraksis i teknologivirksomheder er allerede ved at ændre sig. I en TED-tale om "Hvorfor teknologi har brug for humaniora, "Eric Berridge - administrerende direktør for det IBM-ejede teknologikonsulentfirma Bluewolf - forklarer, hvorfor hans virksomhed i stigende grad ansætter humanistiske kandidater."

Mens videnskaberne lærer os, hvordan man bygger ting, det er humaniora, der lærer os, hvad vi skal bygge, og hvorfor vi skal bygge dem.

Kun 100 af Bluewolfs 1, 000 medarbejdere har uddannelser inden for datalogi og ingeniør. Selv Chief Technology Officer er en engelsk major.

Uddannelse til en lysere fremtid

Tilsvarende Matt Reaney, administrerende direktør og grundlægger af Big Cloud - en rekrutteringsvirksomhed, der er specialiseret i datavidenskab, maskinlæring og AI-ansættelse – har argumenteret for, at teknologien har brug for flere mennesker med humanistisk uddannelse. "[Humaniora] giver kontekst til den verden, vi opererer i dag til dag. Kritisk tænkning, færdigheder, dybere forståelse af verden omkring os, filosofi, etik, meddelelse, og kreativitet tilbyder forskellige tilgange til problemer fra teknologi."

Reaney foreslår en "mere blandet tilgang" til videregående uddannelse, tilbyder grader, der kombinerer kunst og STEM.

En anden fortaler for den tværfaglige tilgang er Joseph Aoun, Præsident for Northeastern University i Boston. Han har hævdet, at i AIs tidsalder, videregående uddannelser bør fokusere på det, han kalder "humanik, " at udstyre kandidater med tre nøglefærdigheder:teknologisk læsefærdighed, datafærdighed og menneskelig læsefærdighed.

Tiden er inde til at besvare opfordringen til humanistiske kandidater, der er i stand til at krydse over i teknologiens verden, så vores menneskelige fremtid kan være så lys som muligt.

Uden uddannelse i etik, menneskerettigheder og social retfærdighed, de mennesker, der udvikler de teknologier, der vil forme vores fremtid, kan træffe dårlige beslutninger. Og den fremtid kan vise sig at være en af de ulykker, vi allerede har set på skærmen.

Denne artikel er genudgivet fra The Conversation under en Creative Commons-licens. Læs den originale artikel.

Varme artikler

Varme artikler

-

Clickety clack, lad os se tilbage:Skrivemaskiner vender tilbageDenne 28. juni, 2019-billedet viser Paul Schweitzer stående i Gramercy Typewriter Co.-værkstedet i New York, ved siden af en hylde med vintage skrivemaskiner. Schweitzer, der med sin søn, ejer Grame

Clickety clack, lad os se tilbage:Skrivemaskiner vender tilbageDenne 28. juni, 2019-billedet viser Paul Schweitzer stående i Gramercy Typewriter Co.-værkstedet i New York, ved siden af en hylde med vintage skrivemaskiner. Schweitzer, der med sin søn, ejer Grame -

Sig tak og venligst:Skal du være høflig med Alexa og Google Assistant?Kredit:CC0 Public Domain Jeremy Bloom har en høflig familie. Men efter et par frustrerende mislykkede forsøg, hvor Bloom høfligt bad Alexa om at skrue ned for lydstyrken ved middagstid, råbte han

Sig tak og venligst:Skal du være høflig med Alexa og Google Assistant?Kredit:CC0 Public Domain Jeremy Bloom har en høflig familie. Men efter et par frustrerende mislykkede forsøg, hvor Bloom høfligt bad Alexa om at skrue ned for lydstyrken ved middagstid, råbte han -

Eagle-eyed machine learning algoritme overgår menneskelige eksperterStrålingsskadede materialer ligner en krateret måneoverflade, og maskinlæring kan nu hjælpe med atomreaktordesign ved at finde en specifik række defekter hurtigere og mere præcist end ekspertmennesker

Eagle-eyed machine learning algoritme overgår menneskelige eksperterStrålingsskadede materialer ligner en krateret måneoverflade, og maskinlæring kan nu hjælpe med atomreaktordesign ved at finde en specifik række defekter hurtigere og mere præcist end ekspertmennesker -

Renault-Nissan alliance tager Google Android en turRenault vil give chauffører en digital kontinuitet mellem bilen og omverdenen Renaults alliance med Nissan og Mitsubishi sagde tirsdag, at de ville begynde at udstyre sine biler med Android-operat

Renault-Nissan alliance tager Google Android en turRenault vil give chauffører en digital kontinuitet mellem bilen og omverdenen Renaults alliance med Nissan og Mitsubishi sagde tirsdag, at de ville begynde at udstyre sine biler med Android-operat

- Forskere transmitterer energi med laser i historisk strømstrålende demonstration

- Der er behov for en mere modig indsats mod luftforurening efter nye WHO-retningslinjer

- Hvordan isolerer jeg bakterier fra jord?

- Har børn mistet et helt års skolegang og social udvikling? Det kommer an på, siger eksperter

- Selvkørende den længste rute endnu

- Hvordan adskiller mennesker sig fra vores forfædre?