San Franciscos anklagere henvender sig til kunstig intelligens for at reducere racemæssig skævhed

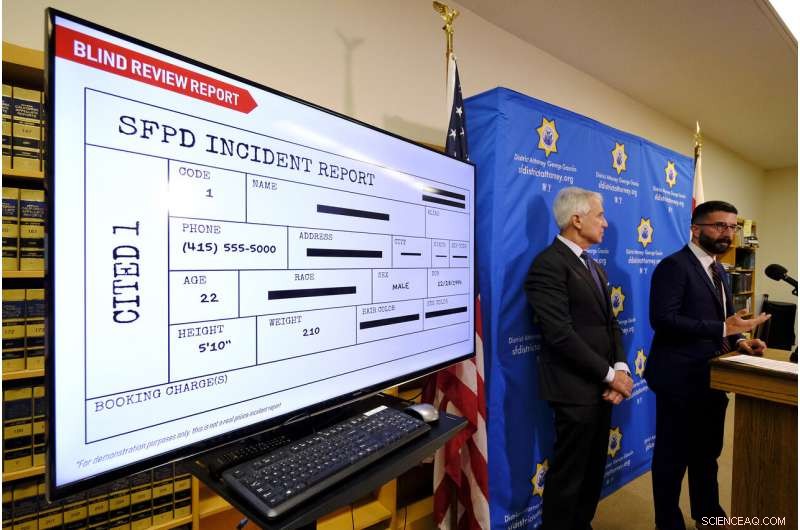

Med en blind politihændelsesrapport vist, San Francisco distriktsadvokat George Gascon, venstre, og Alex Chohlas-Wood, underdirektør, Stanford Computational Policy Lab, tale om implementeringen af et kunstig intelligensværktøj til at fjerne potentialet for skævhed i opkrævningsbeslutninger, under et pressemøde onsdag d. 12 juni, 2019, i San Francisco. I et første af sin slags eksperiment, San Franciscos anklagere henvender sig til kunstig intelligens for at reducere skævhed i kriminaldomstolene. (AP Photo/Eric Risberg)

I et første af sin slags eksperiment, San Franciscos anklagere henvender sig til kunstig intelligens for at reducere racemæssig skævhed i domstolene, vedtage et system, der fjerner visse identificerende detaljer fra politirapporter og kun overlader nøglefakta til at styre sigtelsesbeslutninger.

Distriktsadvokat George Gascon meddelte onsdag, at hans kontor vil begynde at bruge teknologien i juli for at "tage kapløbet ud af ligningen", når han skal beslutte, om han skal anklage mistænkte for en forbrydelse.

Kriminalretseksperter siger, at de aldrig har hørt om noget lignende projekt, og de bifaldt ideen som en kreativ, fed indsats for at gøre opladningspraksis mere farveblind.

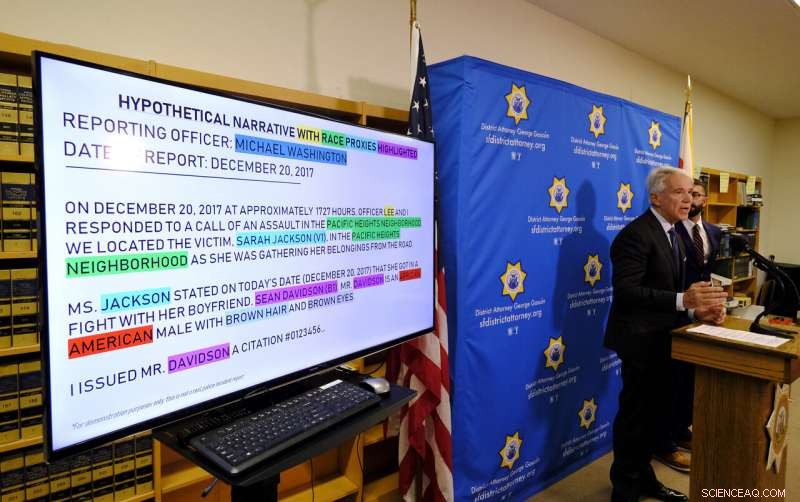

Gascons kontor arbejdede sammen med datavidenskabsmænd og ingeniører på Stanford Computational Policy Lab for at udvikle et system, der tager elektroniske politirapporter og automatisk fjerner en mistænkts navn, race og hår- og øjenfarver. Navne på vidner og politibetjente vil også blive fjernet, sammen med specifikke kvarterer eller distrikter, der kunne indikere racen for de involverede.

"Det strafferetlige system har haft en frygtelig indvirkning på farvede mennesker i dette land, især afroamerikanere, i generationer, " sagde Gascon i et interview forud for meddelelsen. "Hvis alle anklagere tog race ud af billedet, da de traf sigtelsesbeslutninger, vi ville sandsynligvis være et meget bedre sted som nation, end vi er i dag."

Med en hypotetisk politirapport vist, San Franciscos distriktsadvokat George Gascon taler om implementeringen af et kunstig intelligensværktøj til at fjerne potentialet for skævhed i opkrævningsbeslutninger under en pressekonference onsdag, 12 juni, 2019, i San Francisco. I et første af sin slags eksperiment, San Franciscos anklagere henvender sig til kunstig intelligens for at reducere skævhed i kriminaldomstolene. De vedtager et system, der fjerner visse identificerende detaljer fra politirapporter og overlader kun nøglefakta til at styre sigtelsesbeslutninger. Gascon meddelte, at hans kontor vil begynde at bruge teknologien i juli for at "tage race ud af ligningen", når han beslutter sig for, om de skal anklage mistænkte for en forbrydelse. (AP Photo/Eric Risberg)

Gascon sagde, at hans mål var at udvikle en model, der kunne bruges andre steder, og teknologien vil blive tilbudt gratis til andre anklagere i hele landet.

"Jeg roser dem virkelig, det er et modigt træk, " sagde Lucy Lang, en tidligere New York City anklager og administrerende direktør for Institute for Innovation in Prosecution ved John Jay College of Criminal Justice.

Teknologien er afhængig af mennesker til at indsamle de første fakta, som stadig kan påvirkes af racemæssig skævhed. Anklagemyndigheden vil træffe en indledende sigtelsesbeslutning baseret på den redigerede politianmeldelse. Så vil de se på hele rapporten, med gendannet detaljer, for at se, om der er nogen formildende grunde til at genoverveje den første beslutning, sagde Gascon.

Lang og andre eksperter sagde, at de ser frem til at se resultaterne, og at de forventer, at systemet er et igangværende arbejde.

-

San Francisco distriktsadvokat George Gascon, venstre, annoncerer implementeringen af et kunstig intelligensværktøj til at fjerne potentialet for bias i opkrævningsbeslutninger som Alex Chohlas-Wood, underdirektør, Stanford Computational Policy Lab, lytter under et pressemøde onsdag, 12 juni, 2019, i San Francisco. I et første af sin slags eksperiment, San Franciscos anklagere henvender sig til kunstig intelligens for at reducere skævhed i kriminaldomstolene. (AP Photo/Eric Risberg)

-

San Francisco distriktsadvokat George Gascon, venstre, annoncerer implementeringen af et kunstig intelligensværktøj til at fjerne potentialet for bias i opkrævningsbeslutninger som Alex Chohlas-Wood, underdirektør, Stanford Computational Policy Lab, lytter under et pressemøde onsdag, 12 juni, 2019, i San Francisco. I et første af sin slags eksperiment, San Franciscos anklagere henvender sig til kunstig intelligens for at reducere skævhed i kriminaldomstolene. (AP Photo/Eric Risberg)

-

I denne tirsdag, 16. februar, 2016 filbillede, San Franciscos distriktsadvokat George Gascon vises på en pressekonference i San Francisco, På onsdag, 12 juni, 2019, Gascon annoncerer, hvad der ser ud til at være det første af sin slags program, der bruger kunstig intelligens til at mindske skævhed i det strafferetlige system. Fra næste måned, anklagere vil beslutte, om en mistænkt skal sigtes baseret på "farveblinde" politirapporter i hvilke navne, race og andre identificerende detaljer er blevet fjernet. (AP Photo/Jeff Chiu)

"Hatten af for at prøve nye ting, " sagde Phillip Atiba Goff, formand for Center for Politiets Equity. "Der er så mange kontekstuelle faktorer, der kan indikere race og etnicitet, at det er svært at forestille sig, hvordan selv et menneske kunne fjerne det hele."

En undersøgelse fra 2017 bestilt af San Franciscos distriktsadvokat fandt "væsentlige racemæssige og etniske forskelle i strafferetlige resultater." Afroamerikanere repræsenterede kun 6 % af amtets befolkning, men tegnede sig for 41 % af anholdelserne mellem 2008 og 2014.

Undersøgelsen fandt "små beviser for åbenlys skævhed mod enhver race eller etnisk gruppe" blandt anklagere, der behandler kriminelle handlinger. Men Gascon sagde, at han ønskede at finde en måde at hjælpe med at eliminere en implicit bias, der kunne udløses af en mistænkts race, et etnisk klingende navn eller et kriminelt kvarter, hvor de blev anholdt.

Efter det er begyndt, programmet vil blive gennemgået ugentligt, sagde Maria Mckee, DA's direktør for analyse og forskning.

Tiltaget kommer efter, at San Francisco i sidste måned blev den første amerikanske by, der forbød brugen af ansigtsgenkendelse af politiet og andre byagenturer. Beslutningen afspejlede et voksende tilbageslag mod AI-teknologi, efterhånden som byer søger at regulere overvågning fra kommunale instanser.

© 2019 The Associated Press. Alle rettigheder forbeholdes.

Sidste artikelTværfaglig forskning tager tid

Næste artikelUngarske videnskabsmænd er bekymrede over den planlagte regeringsovertagelse

Varme artikler

Varme artikler

-

Tilbage:Hvordan disruptiv teknologi kan vælge samfundets vindere og tabereKredit:CC0 Public Domain Nye platforme som hjemme- og samkørselstjenester får ofte ros for at udjævne vilkårene, skære mellemmanden ud og sætte gang i økonomien. Det er svært helt at forstå deres

Tilbage:Hvordan disruptiv teknologi kan vælge samfundets vindere og tabereKredit:CC0 Public Domain Nye platforme som hjemme- og samkørselstjenester får ofte ros for at udjævne vilkårene, skære mellemmanden ud og sætte gang i økonomien. Det er svært helt at forstå deres -

Modedesignere er faktisk ikke smagsdiktatorer, undersøgelse finderKredit:Unsplash/CC0 Public Domain Det meste af litteraturen om innovation udvikler sig i forbindelse med teknologi, hvor graden af radikal eller trinvis ændring med hensyn til produktets funktio

Modedesignere er faktisk ikke smagsdiktatorer, undersøgelse finderKredit:Unsplash/CC0 Public Domain Det meste af litteraturen om innovation udvikler sig i forbindelse med teknologi, hvor graden af radikal eller trinvis ændring med hensyn til produktets funktio -

Selv når kvinder er flere end mænd, kønsbias fortsætter blandt de naturvidenskabelige bachelorerKredit:CC0 Public Domain At øge kønsdiversiteten har været et længe søgt mål på tværs af mange af videnskaberne, og interventioner og programmer for at tiltrække flere kvinder til områder som fysi

Selv når kvinder er flere end mænd, kønsbias fortsætter blandt de naturvidenskabelige bachelorerKredit:CC0 Public Domain At øge kønsdiversiteten har været et længe søgt mål på tværs af mange af videnskaberne, og interventioner og programmer for at tiltrække flere kvinder til områder som fysi -

Gå ikke ud fra, at onlinestuderende er mere tilbøjelige til at snyde. Beviserne er skumleDu skulle tro, at det at studere online ville gøre det lettere at snyde. Men hop ikke for konklusioner. Kredit:Christin Hume/Unsplash Flere universitetsstuderende vælger at studere online frem for

Gå ikke ud fra, at onlinestuderende er mere tilbøjelige til at snyde. Beviserne er skumleDu skulle tro, at det at studere online ville gøre det lettere at snyde. Men hop ikke for konklusioner. Kredit:Christin Hume/Unsplash Flere universitetsstuderende vælger at studere online frem for

- Sektion af DNA eller RNA, der ikke kode for proteiner

- Eksistensen af todimensionelt nanomateriale silicen stilles spørgsmålstegn ved

- Konvertering af solenergi til brintbrændstof, med hjælp fra fotosyntese

- Hvordan succes avler succes i videnskaberne

- Usikre ansættelser inden for uddannelse påvirker arbejdere, familier og studerende

- Fjernmålingens etik i arkæologi